О чем речь? Единицы измерения количества информации – это азы информатики, которые должен знать каждый, начинающий свою деятельность в сфере IT. Без понимания этих терминов будет сложно понять суть языков программирования, кодирования.

Какие различают? Основных единиц измерения информации всего две, остальные — производные от них. Разобравшись в базе, далее изучение пойдет как по маслу. Немаловажно еще понять разница между международной и российской стандартизацией этих единиц.

- Что такое информация

- Единицы измерения количества информации

- Стандартизация единиц измерения информации

Пройди тест и узнай, какая сфера тебе подходит:

айти, дизайн или маркетинг.

Бесплатно от Geekbrains

Что такое информация

Прежде чем перейти к изучению единиц измерения количества информации в информатике, необходимо разобраться с самим понятием «информация». Это фундаментальный термин в компьютерной науке, который включает в себя сразу несколько составляющих:

Информатика 7 класс (Урок№6 — Единицы измерения информации.)

- новые познания, не известные ранее факты и сведения;

- данные о различных предметах и событиях окружающей среды, повышающие грамотность и уровень эрудированности человека;

- данные о различных предметах и событиях окружающей среды, снижающие степень неясности их природы и сущности при принятии человеком каких-либо решений.

«Информация» – термин, который применяется абсолютно во всех науках, а значит, существуют стандартизированные единицы измерения количества информации.

При этом каждое научное течение под информацией соотносит совершенно разные системы знаний и понятий: в биологии она тесно связана с генетикой и анализом механизмов наследственности, физика идентифицирует этот термин как меру упорядоченности, в кибернетике информация является ключевым элементом в организации и управлении различными динамическими системами.

К основным свойствам информации относятся:

- социальная значимость, важность, полезность;

- широкая доступность, достаточная объёмность;

- ясность, точность, определённость;

- надёжность, соответствие истине;

- общественная пригодность.

Окружающий нас мир наполнен множеством информационных процессов, постоянно сменяющих друг друга: люди получают информацию извне, воспринимают и перерабатывают её с помощью органов чувств, на основе чего принимают определённые решения, которые при их реализации влияют на внешнюю среду и изменяют её.

Прежде чем рассмотреть основные единицы измерения количества информации, остановимся подробнее на таком понятии, как «информационный процесс». Он включает в себя приём, передачу, переработку и хранение информации.

Приём информации – процесс, включающий в себя поиск и сбор информационных данных, сведений и сообщений, содержащихся в различных источниках. Существует множество способов сбора информации: получение данных из литературы, книг, справочников, информационных сетей и систем; осуществление наблюдения за объектами и явлениями; проведение различных экспериментов (в том числе опросов, тестов, анкетирования).

Просто о битах, байтах и о том, как хранится информация #2

Для вас подарок! В свободном доступе до 09.07 —>

Скачайте ТОП-10 нейросетей, которые помогут облегчить

вашу работу

Чтобы получить подарок, заполните информацию в открывшемся окне

Передача информации – это обмен информационными данными, сведениями и сообщениями между источником и приёмником, осуществляемый по определённому каналу связи. Существует множество форм передачи информационных данных: с помощью текста, изображений, звука, электричества, световых и ультразвуковых сигналов и пр. К каналам передачи информации относятся люди и другие живые организмы, нервные клетки, воздушное и водное пространство, электрокабели и пр.

Хранение информации – это процесс закрепления данных на определённом носителе. В качестве носителей могут выступать бумага, металл, текстиль, плёнка для записи видео, фотоплёнка, дискета, CD-диск, флэш-накопитель и пр.

Переработка информации – это процесс взаимодействия с информацией, при котором из имеющихся данных получаются новые информационные сведения и сообщения. Увеличение имеющегося объёма информации происходит, преимущественно, за счёт её обработки.

Защита информационных данных предполагает формирование безопасных условий, гарантирующих сохранность информации и минимизирующих риски её утери, повреждения, несанкционного доступа и изменения. К основным методам защиты информации относятся копирование на другие носители, хранение в местах с усиленной защитой, кодирование данных, ограничение прав доступа для определённого круга лиц и пр.

Издревле для передачи и хранения информации применялись символы.

По типу восприятия символы подразделяются на:

- зрительные (цифровые и буквенные обозначения, знаки дорожного движения, ноты, математические символы и пр.);

- слуховые (голосовая речь, музыка, сирены и пр.);

- обонятельные (запахи, ароматы и пр.);

- осязательные (прикосновения, шрифт Брайля для слабовидящих и слепых людей и пр.);

- вкусовые (сладость, горечь и пр.).

Информация может передаваться от источника к приёмнику в виде звуковых и световых сигналов, например, сирена скорой помощи, направление движения на светофоре.

По взаимосвязи между формой реализации и смысловым значением символы подразделяются на:

- иконические: форма их изображения напоминает сам предмет, который они обозначают (например, значок корзины на рабочем столе компьютера);

- знаки: взаимосвязь между формой изображения и смысловым значением идентифицируется по общепринятому стандарту (например, математические знаки).

Информационные данные могут быть представлены с помощью языков – знаковых систем, в основе которых лежит алфавит, с помощью которого составляются текстовые сообщения, а также формируется свод правил осуществления операций над символами.

- естественные (французский, испанский, русский и пр.);

- формальные – специализированные языки, используемые в определённых сферах деятельности (язык программирования, азбука Морзе, системы счисления и пр.).

Единицы измерения количества информации

Минимальная единица измерения количества информации – бит. Термин «бит» произошёл от английского сокращения bit (или binary digit), что в дословном переводе означает «двоичная цифра».

Бит – это такое количество информации, которое является достаточным для установки различий между двумя явлениями, имеющими одинаковую вероятность.

Один бит идентифицирует одно из двух понятий: 0 либо 1 (включено или выключено, верно или неверно, да или нет и пр.).

Бит является наименьшей единицей измерения количества информации. На практике чаще всего используют более крупную единицу – байт. Один байт – это восемь бит.

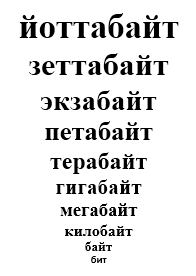

Единицы измерения количества информации по возрастанию:

- 1 Килобайт = 1024 байт;

- 1 Мегабайт = 1024 Килобайт;

- 1 Гигабайт = 1024 Мегабайт;

- 1 Терабайт = 1024 Гигабайт;

- 1 Петабайт = 1024 Терабайт.

Единицы измерения информации

Компьютерная техника использует двоичную систему счисления, выбор которой определяется реализацией аппаратуры компьютера (электронными схемами) с использованием двоичного элемента хранения данных — триггера. Триггер имеет два возможных состояния (включено — условно обозначается $1$, и выключено — $0$) и может хранить минимальный объем данных равный $1$ биту.

Бит является элементарной единицей объема информации вне зависимости от ее содержания.

Количество всех возможных комбинаций $0$ и $1$ в $n$ триггерах равно $2n$.

Т.к. формально появление нуля или единицы в ячейке можно ожидать с одинаковой вероятностью, то, применив формулу Хартли:

можно сделать вывод, что в $n$ триггерах можно хранить $n$ бит информации.

Определение 1

Бит — это количество информации, которое содержится в сообщении и вдвое уменьшает неопределенность знаний о чем-либо.

Т.к. бит — минимальная единица измерения информации, объем информации в $1$ бит является слишком малой величиной, поэтому принято для измерения информации использовать более крупную единицу — $1$ байт, который является основной единицей измерения информации.

Байтом называют последовательность из $8$ бит:

В компьютерной технике наименьшей адресуемой единицей принято считать $1$ байт.

В $1$ байте можно хранить, например, $1$ символ.

В настоящее время для хранения информации в компьютерной технике используют более крупные единицы объема информации:

Замечание 1

В Кбайтах, Мбайтах, Гбайтах и т.д. измеряется также потенциальная информационная ёмкость оперативной памяти и запоминающих устройств, предназначенных для хранения данных (магнитные, лазерные, жесткие диски, флэш-накопители и т.д.).

«Единицы измерения информации»

Готовые курсовые работы и рефераты

Решение учебных вопросов в 2 клика

Помощь в написании учебной работы

Если проследить какой стороной упадет подброшенная монета, мы получаем определенную информацию. Можно считать, что обе стороны монеты равноправны, т.е. с одинаковой вероятностью может выпасть как одна, так и другая сторона. В таком случае говорят, что событие несет информацию в $1$ бит.

Если вытащить из мешка вслепую один из двух шаров разного цвета, мы также получаем информацию о цвете шара в $1$ бит.

Вычислить, сколько бит информации будет нести сообщение о том, в какой из восьми коробок находится шар.

Решение:

Применим формулу Хартли:

Ответ: сообщение будет нести $3$ бита информации.

Найти информационный объем одного символа русского языка.

Решение:

Количество букв русского языка равно $32$ (букву «ё» учитывать не будем, т.к. она редко используется). Таким образом, количество равновероятных событий $32$, т.е. $n=32$.

По формуле Хартли найдем информационный объем одного символа:

Ответ: информационный объем одной буквы русского языка равен $5$ битам.

В случае, когда невозможно найти целую степень числа, то округлять необходимо производить в сторону увеличения.

Найти информационный объем одного символа английского алфавита.

Решение:

Количество букв английского алфавита равно $26$. Таким образом, количество равновероятных событий $26$, т.е. $n=26$.

По формуле Хартли найдем информационный объем одного символа:

[26=2^i;] [2^4Ответ: информационный объем одной буквы английского алфавита равен $5$ битам.

На световом табло размещены лампочки, каждая из которых может принимать два значения («включено» или «выключено»). Найти наименьшее количество лампочек, которые нужно разместить на табло, чтобы с его помощью можно было передать $50$ различных сигналов?

Решение:

С помощью $n$ лампочек, каждая из которых может принимать одно из двух состояний, можно закодировать $2^n$ сигналов:

[2^5Ответ: наименьшее количество лампочек, необходимых для передачи $50$ различных сигналов равно $6$.

На метеостанции ведется наблюдение за влажностью воздуха. Результаты каждого измерения являются целым числом от $0$ до $50$, которое записывается при помощи минимально возможного количества битов. Станция произвела $60$ измерений. Найти информационный объем результатов наблюдений.

Решение:

В данном случае количеством равновероятных событий является множество чисел от $0$ до $50$, т.е. $51$ значение:

[2^5Одно измерение равно $6$ битам. Т.к. измерений было проведено $60$, то общий информационный объем равен: [6 cdot 60=360 бит.]

Переведем в байты:

Ответ: $360$ бит = $45$ байт.

Найти информационный объем (в битах) предложения:

Кто владеет информацией — тот владеет миром!

Решение:

Каждый символ кодируется $1$ байтом. Подсчитаем количество символов, включая знаки препинания и пробелы. Получаем всего $44$ символа. Значит информационный объем данного предложения равен:

[1 байтcdot 44 символа=44 байт cdot 8=352 бит.]

Ответ: $352$ бит.

Источник: spravochnick.ru